—¿Cuánto la mecánica cuántica altera el curso de la filosofía?

—La mecánica cuántica es la mejor teoría que los humanos hemos construido para comprender la naturaleza. En ese sentido, altera todo el curso de la filosofía. Para que la gente entienda un poquito por qué la mecánica cuántica tiene este carisma tan especial, es que las leyes de la física clásica que estamos acostumbrados, las leyes de Newton, no tienen validez en el mundo de las partículas subatómicas ni en los átomos. Hemos descubierto toda esta nueva forma de construir la teoría, de cómo describir los átomos, desde principios del siglo XX. La primera ecuación cuántica es del 7 de octubre de 1900. Lo que no nos esperábamos es que al llegar a controlar la materia a nivel de sus elementos mínimos, es decir a nivel de átomos, a nivel de protones, a nivel de electrones, de fotones, ha aparecido algo inesperado, y es que las leyes de la mecánica cuántica nos permiten calcular, nos permiten hacer computación cuántica, le llamamos, de una forma radicalmente diferente a la que ustedes utilizan en un ordenador de sobremesa. Estamos ahora en plena batalla en la Tierra por liderar la nueva forma de computar. Es decir, queremos saber cuáles son las ventajas de un ordenador cuántico, para qué nos va a servir y en qué sentido, pues, los países que ostenten la computación cuántica, el conocimiento de computación cuántica, van a seguir liderando la tecnología del futuro.

—¿En qué se diferencia una computadora cuántica de una normal y cómo se relaciona una computadora cuántica con la inteligencia artificial cuántica?

—La computadora cuántica requiere necesariamente vivir en el mundo de la mecánica cuántica, el mundo de lo muy pequeño, de lo que está controlado, en la que un átomo queda libre en medio del espacio, todos los demás influencian sobre él y lo alteran. Entonces, si hemos codificado información en un átomo, se pierde inmediatamente. Eso nos fuerza a construir ordenadores cuánticos, que son unas de las máquinas más precisas que los humanos hemos creado. Pero para que se haga una idea, un tipo de ordenador cuántico se hace con lo que se llama corriente de superconductores. Hemos de bajar a la temperatura de diez milikelvin, es decir -273 grados, donde de repente frenamos el universo y la mecánica cuántica aparece en toda su plenitud. Ahí es donde logramos entonces manipular la información, codificarla, procesarla, de una manera increíblemente eficiente. La segunda parte de su pregunta era en qué altera la inteligencia artificial. La inteligencia artificial es cómputo. No hay otra cosa. Es un algoritmo, es cómputo. Entonces, las mejores máquinas nos van a proporcionar la mejor inteligencia artificial. Al día de hoy, utilizamos estas máquinas que se llaman GPUs. Y el éxito de las GPUs tal vez se pueda vivir porque la empresa Nvidia se ha convertido en la mayor de la Tierra. En un futuro seguramente la computación cuántica será el instrumento de cómputo que necesitaremos para lograr la máxima inteligencia artificial posible.

—Usted vive en Singapur, entre otros motivos porque está desarrollando una computadora cuántica, ¿cuál es la importancia de que un país pueda desarrollar esa tecnología para el futuro del desarrollo de ese mismo país?

—Me gustaría ser a la vez educado y a la vez directo, hay que lograr un equilibrio. Vivimos el siglo XXI, no vivimos el siglo XII, y uno pertenece a los países donde se define la tecnología, donde se construye la tecnología o donde se compra la tecnología. Los países tienen que decidir si son generadores de conocimiento o son compradores de los resultados del conocimiento. Singapur tiene solo 5 millones y medio de personas, pero es un país exquisitamente ordenado que no tiene ningún tipo de corrupción, donde la economía es muy sólida. Singapur no tiene materias primas, no puede producir alimentos, no puede producir esencialmente nada. Su economía debe basarse necesariamente en el conocimiento, y de ahí que Singapur es uno de los países que han hecho un plan estratégico cuántico que, por científico, tiene una financiación mayor. Usted compara cuánto ha puesto Francia y cuánto ha puesto Singapur, por científico, y Singapur ha puesto mucho más, no más, mucho más. Le puedo confesar que ayer estaba con uno de los filtros que tenemos, aquí hay millones de filtros donde se aprueban proyectos, son evaluados por decenas de personas y ayer estaba con lo que se llama un Senior Advisor, una de las personas que son asesoras del gobierno, incuestionables, personas muy buenas, esta era una mujer, y toda la reunión fue muy bien, esto es investigación, y qué haremos con esa investigación, qué desarrollaremos, qué economía tendrá Singapur, cómo garantizamos el bienestar de nuestros ciudadanos en el futuro. Y le puedo decir que no fue una reunión trivial, fue dura. Dicho esto, jamás cuestionó que hubiera que invertir. Solo que ella quería ver un plan de utilización de la tecnología del conocimiento que se genera en Singapur. Nos estamos convirtiendo en uno de los hubs, es la palabra que se suele utilizar, más importantes de la Tierra. En los últimos meses ya son muchas las empresas que van a venir aquí a asentar su segunda sede, para estar en el corazón de donde se está desarrollando la tecnología cuántica. No tengo que ser chauvinista, obviamente, Estados Unidos de Norteamérica es uno de los países más potentes, lidera. China está liderando también una parte. Europa va un poquito rezagada, pero tiene el gran conocimiento. Países como los Emiratos Árabes, donde trabajo un tercio de mi tiempo, están haciendo un cambio sustancial en lo que significa liderar un país. Están yéndose fuera de lo que sería el petróleo y empezaron a construir una sociedad de conocimiento. De ahí que creásemos un centro potentísimo en el año 2020. Hay una gran guerra geopolítica, no me gustaría abusar de esa palabra, creo que se ha abusado mucho. Pero en este caso es verdad, hay una guerra geopolítica, aquí hay una verdadera lucha por ostentar el conocimiento, por tener los mejores científicos, dotarlos de medios y que generen la computación, la comunicación cuántica, los sensores cuánticos para la medicina, toda la nueva tecnología que se nos viene encima.

“Cada vez que los humanos hemos logrado algo grande, lo hemos usado primero para el mal”

—¿Por qué Europa está retrasada respecto a la inteligencia artificial y en particular del desarrollo de lo cuántico?

—Por su incapacidad de eliminar la burocracia, por su incapacidad de tomar apuestas firmes por las personas correctas. Es, en mi opinión, Europa, el estandarte de la ética, es la zona de la tierra donde más se evalúan las consecuencias de la tecnología. Y eso está muy bien, he pertenecido al Comité Asesor para Ética del gobierno de España, y creo que es necesario. Ciencia sin ética no tiene sentido. Pero, por otra parte, debería dotarse de mecanismos extremadamente ágiles para poder competir contra los países de la Tierra. Es una pena porque el mayor número de universidades sólidas está en Europa, son cientos de universidades muy buenas, frente a cantidades mucho menores en otros países. Luego, la importación de cerebros es dramática, hay cinco grandes centros de cuántica y en un momento dado, tres estaban dirigidos por españoles. Algo se hará bien en las universidades por qué no se les da ese liderazgo en España. Tengo millones de amigos en Argentina, y de ahí han salido científicos notables. Pero de nuevo, es muy difícil traducir ese conocimiento en realidad económica si no hay unas apuestas extremadamente firmes y claras. Vivimos un milenio que es diferente al anterior, un siglo que es diferente al anterior, pero seguimos discutiendo en términos que ahora, en mi opinión, son obsoletos.

“Las que tienen el límite del conocimiento hoy no son las universidades sino las corporaciones”

—¿Cómo introduce la ética y cómo se enseña a una inteligencia artificial a discernir éticamente?

—Todo es programable. La inteligencia artificial tiene lo que le queramos poner, no es más que un programa de aprendizaje automatizado. Si uno la modera, será ética. Si uno no la modera, será lo que sea. Es exactamente igual que educar a los humanos. Hay humanos muy bien educados, exquisitamente educados, hay humanos que son salvajes. No es que el cerebro humano fuera o no fuera salvaje, es como ha sido educado. En ese sentido, hay que ser muy vigilantes, hay que supervisar el aprendizaje de inteligencias artificiales profundas. Hay que establecer los mecanismos de verificación. No solo hay que supervisar cómo se entrena, sino verificar el uso que se hace de esa inteligencia artificial y de ahí que reglamentar, establecer las leyes no sea elemental. Es el momento del derecho, esa es la gran palabra con mayúsculas, Derecho con mayúsculas. Es el momento de establecer el principio, los principios que nos han de gobernar. Luego las leyes implementarán estos principios. Pero, por ejemplo, ¿es lícito autorizar a inteligencias artificiales a educar a nuestros niños? ¿Tenemos garantías de que no va a haber sesgo, de que no va a haber adoctrinamiento? ¿Tenemos garantías de que no van a producir un daño psicológico en ciertos niños? ¿Podemos autorizar a las compañías que quieran crear asistentes personales de gente mayor a que eso suceda? ¿Serán esas inteligencias artificiales capaces de arruinar a una persona mayor, de crear una dependencia insólita? No es lo mismo hacer una inteligencia artificial para vender mejor un producto, que eso es perfectamente lícito, que permitir que inteligencias artificiales se relacionen con millones de personas sin una supervisión previa.

—Usted comentó en una charla, a propósito de su libro “Ética para máquinas”, que la Justicia en Estados Unidos estaba haciendo un experimento de inteligencia artificial para asistir a los jueces, ¿cómo se entrena la inteligencia artificial en el caso y qué pasa cuando, no sé si decir la palabra, se equivoca o está mal programada?

—Ese fue el caso. Esta fue una iniciativa de hace ahora ya bastantes años. Se entrenó para establecer el valor de la fianza, y también la prisión preventiva. Y lo que sucedió es que resultó que la inteligencia artificial fue entrenada con casos, que son los casos reales, y entonces creó sesgo, sistemáticamente penalizaba a la población de color y a la gente más humilde, fue un entrenamiento erróneo. Eso levantó todas las alarmas y se frenó el proyecto. Sucedió algo parecido con un proyecto de medicina donde se quería también sustituir a médicos, y eso era incorrecto. Hubo un caso de diagnóstico erróneo, y eso volvió a frenarlo todo. Al día de hoy son mucho mejores. Y se ha entendido que no se trata de hacer una inteligencia infalible, sino una inteligencia que pueda asistir a un médico para que su decisión sea un poquito más sabia. Un médico puede haber visto 300 casos de una enfermedad poco común, la inteligencia artificial puede ver todos los de la Tierra. O sea, tiene una estadística que es inabarcable para un cerebro humano. Entonces esa asistencia, tanto en leyes como en medicina, debería ser muy beneficiosa. De hecho, en los proyectos modernos, por ejemplo, el de España de inteligencia artificial, la idea consiste en crear el equivalente a un GPT para lengua española, pero entrenado con las leyes españolas, que no seguimos la common law, seguimos un Código Penal. Es muy diferente la ley en España que la ley sajona, también en medicina y también en otras áreas que son específicas de la cultura española. Esa inteligencia artificial dará lugar a un modelo fundacional, que podrá ser utilizado por las empresas. Entonces, la idea es que el Centro de Supercomputación de Barcelona, que es el más potente de España, cree esta inteligencia artificial que genere una empresa potente a la cual accedan las demás empresas que quieran mejorar sus actividades. Es decir que tenemos un camino hacia la explotación correcta de la inteligencia artificial, pero los primeros pasos que fueron dados sin supervisión suficiente demostraron que hay que ir con cuidado.

—¿Se podría entonces, programando correctamente a las máquinas, lograr que la inteligencia artificial hasta sea más ética que el promedio de los seres humanos y nos haga mejores a los seres humanos?

—Absolutamente. Claro que sí. Esto es como pensar si usted podría educar a unos humanos, hacer un experimento con humanos de educarlos muy bien, claro que serán más éticos que los señores de la guerra de ciertos países. Claro que van a ser mucho más éticos. El gran poder de la educación, si antes era obvio para muchos, ahora lo será mucho más, porque ahora vamos a educar a seres artificiales. Y también déjeme que haga esta pequeña analogía: los humanos hemos abandonado poco a poco ser el centro de todo. Primero hicimos máquinas que eran más fuertes que nosotros y al día de hoy, pues, usamos coches, ascensores, camiones, grúas, ya hemos aceptado que las máquinas nos superan en fuerza, eso ya no es una discusión. Luego hicimos ordenadores que calculaban más rápido. De nuevo, ya no hay contables antiguos y aquellos que iban sumando columnas de números, nosotros ya utilizamos toda esa tecnología. Usted y yo nos estamos comunicando ahora por un complejísimo sistema de comunicación que implica fibras ópticas, bits que están circulando como secuencias de fotones por fibras ópticas y también a veces por satélites o por debajo del mar. Hemos aceptado que el cómputo lo hace mejor una máquina que un humano. El problema de la inteligencia artificial es que lo que está en juego ahora son las decisiones. Y de forma inexorable, vamos a lograr educar a máquinas para que tomen decisiones supervisadas, sabias, mejores que nosotros. Muchas serán banales. También le voy a dar un ejemplo, cómo se potabiliza el agua de Barcelona, pues con una red neuronal. La decisión de cómo se hace no la hace un humano, la hace una red neuronal. Luego, es obvio que muchas de las tareas que estamos haciendo, que son decisiones, van a ser tomadas ahora por algoritmos muy potentes. El problema está en que, cuando hicimos máquinas, pues ahora tenemos que pagar dinero para ir al gimnasio para no ser superdébiles, que nadie sabe dividir por siete porque tenemos máquinas que dividen muy bien, el problema es que delegar la decisión es un problema ético. Estamos delegando la ética, y ahí es donde hay esa insatisfacción, ese peligro latente que vemos venir y que queremos muchos, al menos yo, que sea hecho de forma lenta. Yo creo que uno de los grandes secretos es que la inteligencia artificial no entre tan rápido, entre más despacito.

“Las mejores mentes humanas, en vez de ir a las universidades, querrán ir a las corporaciones”

—¿Usted cree en Dios?

—Es una palabra no bien definida. Y como buen científico que soy, creo que cuando usted hace esa pregunta, muchas personas tienen detrás un concepto diferente de esa palabra. Entonces, hacer una afirmación sobre eso sería terrible, porque ciertas personas lo entenderían de una manera, ciertas personas de otra.

—Déjeme entonces cruzar esa barrera semántica, ¿usted cree que, como metáfora, Dios es un programador?

—Me gusta mucho. Me gusta la filosofía y me gusta charlar de estos temas. Permítame que introduzca un concepto del que me gusta mucho hablar, la zona templada. Ese es el lugar donde no hay sesgos, no hay polarización, donde no hay idearios políticos, donde no hay idearios económicos, donde se sienta uno con amigos profundos y habla sin sesgo y habla abiertamente, sin esconder problemas, sin defender algo especial. En esa zona templada en la cual tengo bastantes amigos con quienes adoro charlar, cuando hablamos de esto usamos las palabras “el gran arquitecto”. Ahora tal vez debería usar las palabras “gran programador”. No es mía “el gran arquitecto”, como usted sabe, es una palabra que se ha utilizado mucho antes por otras personas, pero no me desagrada, es la gran idea de si el universo tiene unas leyes o un propósito o un origen.

“Los chinos monitorizan la cara de los niños y preseleccionan a los más atentos para escuelas avanzadas”

—Dado que le gusta la filosofía, ¿podría decir que Dios nos programó con el imperativo categórico de Kant, la idea del bien común, y que entonces podríamos replicarlo programando a la inteligencia artificial también con el imperativo categórico?

—El imperativo categórico de Kant, “no le hagas a otro lo que no quieres que te hagan a ti”, no es aplicable en la práctica de verdad. Le voy a dar un ejemplo que me gusta utilizar. Usted tiene una inteligencia que controla a una pistola que está como policía de un banco y ahora aparece un atracador armado, mata a un cliente y levanta la pistola para matar al segundo cliente. Entonces, ¿qué hace esta inteligencia artificial? ¿Qué decisión toma en un milisegundo? No sé qué diría usted, diría: sí, tiene que acabar con el atracador que está matando a la gente. Pero el imperativo de Kant diría que no, porque diría que no hay que hacerle a alguien lo que no quieres que te hagan a ti. O sea, no hay que matar porque no quieres ser matado. Entonces estas ideas, dijéramos muy básicas, como los imperativos categóricos, no son suficientes para establecer las leyes, eso cualquier legislador lo sabe. La ley es mucho más compleja. Se aproxima mucho más a lo que necesitamos, las ideas del utilitarismo de Stuart Mill y Bentham, que establecen que hay que buscar el bien de la mayoría. En ese caso sería muy claro, hay que mantener la mayoría de nuestros humanos vivos. Luego ese señor, el atracador, tiene que fallecer, porque de lo contrario muere más gente. Pero aun así podría encontrar contraejemplos donde el utilitarismo no es suficiente. Entonces eso lo que requiere, en mi opinión, es que a la hora de legislar hacen falta muchas voces, hacen falta voces educadas, voces filosóficas, voces de gente del derecho, gente de la economía, porque también hay que reconocer que todo esto tiene que ver con nuestro bienestar y debe avanzar en ese sentido. Otro ejemplo, usted puede decir: esto es tan complicado que no legislamos y lo prohibimos todo. En esa situación habrá otros países, como China, que van a avanzar dramáticamente y dentro de un tiempo seremos esclavos de otra civilización, con lo cual, de nuevo, no es válido el prohibirlo todo. Hay un componente económico que debe ser atendido a la hora de legislar. Todo lo hace un poquito complicado y de ahí que no haya sido fácil pasar los primeros pasos de las leyes en Europa. Le diré que además se mezcla el hecho de que hay que legislar en 28 países que tienen leyes diferentes y que lo nuevo no es todo nuevo. Hay cosas que ya existen, por ejemplo aplicaciones de tecnología en medicina ya están reglamentadas. ¿Por qué la inteligencia artificial no es una más? Entonces hay que delimitar muy bien qué es lo que ya está legislado de lo que necesita ser legislado, y eso no es fácil.

—Escuchándolo, me viene a la mente una ironía de Leibniz cuando dijo: terminemos esta discusión, calculemos quién tiene razón. Lo escucho hablar de cómputos y no cabe ninguna duda de que las computadoras son infinitamente mejores para comparar iguales. La pregunta es cuándo tienen que ponderar entre desiguales, ¿cómo se resuelve eso computacionalmente?

—Desde los años 60, que arranca la inteligencia artificial más primitiva, ahora hemos avanzado muchísimo. Hemos aprendido a tratar datos que son incompatibles e inconsistentes. Me parece increíble, pero lo hemos logrado. De ahí que una computadora ahora habla con un humano, a pesar de que el humano entra en muchas contradicciones. Seguimos aprendiendo. Diría que cualquier cosa que hace nuestro cerebro seremos capaz de replicarla. Si lo va a hacer bien o lo va a hacer mal, va a haber opiniones. Por ejemplo, se habla de que haya políticos artificiales, hay una anécdota que me hace gracia, en Estados Unidos se hacen encuestas para cualquier cosa y se hizo una sobre si tenía sentido o no tener el Partido Demócrata, el Republicano y un partido artificial para que emita opiniones en casos complicados. Y para sorpresa de muchos, un tercio de la gente ya quería tener esa opción. No me parece totalmente estúpido. Si queremos entender cómo gestionar la energía de una ciudad, que acaba siendo una tarea de un político decir qué se va a hacer. El agua en Barcelona, que es mi ciudad, donde siempre hay sequías, una inteligencia artificial puede ser alimentada con los casos de millones de muchísimas ciudades. Puede saber todo, cómo se gestiona el agua en los países árabes, que es un bien preciado y que lo han optimizado de forma brutal. Singapur, el agua es uno de los países que mejor la trata de la Tierra, al ser una isla tienen que ir con cuidado. Pues, además de tener los partidos locales, los nacionales, los de izquierdas, los de derechas, los que tienen el sesgo de tal, si hubiera un partido que dijera, si no hubiera política, lo que habría que hacer estaciones para desalinizar agua en tales lugares de la costa, que son los óptimos, que son los lugares donde habría menos impacto medioambiental y demás, estaría muy bien saber eso. O sea que no veo imposible que haya asesores artificiales políticos.

“No va a haber derechas e izquierdas, va a haber una relación entre humanos y máquinas, y jóvenes y viejos”

—Quiero entrar en el tema de actualidad de la semana, que son cuatro Premios Nobel de Física y Química, relacionados todos con la inteligencia artificial. El ganador del Premio Nobel de Física, Geoffrey Hinton, renunció a Google y se arrepintió de la inteligencia artificial, exagerando con el arrepentimiento que se le asigna a Einstein a mediados de los 50 con la energía atómica. Algo que bien usado produce enormes beneficios en la generación de energía y mal usado, destrucción, ¿hay punto de contacto con el temor de que el invento se use para destruir en lugar de construir?

—Quisiera matizar un poquito, porque muy a menudo se cita a Einstein sin ser correcto, no tuvo nunca ese gran arrepentimiento. Otros sí, pero Einstein, en concreto, no. Cada vez que los humanos hemos logrado algo grande, lo hemos usado primero de todo, para el mal. Cuando el humano descubre el fuego, lo primero que hizo fue quemar a otros humanos, a las aldeas de los demás. Cuando entendimos la energía atómica, la primera aplicación que se hizo fue una bomba atómica. Cuando hemos entendido la biología, se hicieron armas biológicas. Los humanos, por defecto, tenemos un componente tremendamente agresivo y violento por nuestra historia evolutiva de luchar por los recursos, que nos hace salvajes. Luego, poquito a poco, va imponiéndose la racionalidad. La racionalidad es lenta. El sentido común llega después, lo domina todo y es lento. Al día de hoy, pues, nadie opina que el fuego sea el gran problema de los humanos. La energía nuclear, pues, también. No se dice, pero en Francia más de la mitad de su energía viene de la energía nuclear. Estados Unidos también, Suecia también, y así muchos países. Con la inteligencia artificial, pues, pasará lo mismo, va a haber aplicaciones terribles. Cito una que era, estos colegios chinos que monitorizan la cara de los niños para detectar cuáles están más atentos y a los cuatro años ya preseleccionarlos para escuelas avanzadas, o no, eso es cruel al no respetar la evolución del niño. Luego los humanos siempre hacemos el mal y luego, poquito a poco, pasamos a hacer el bien con la tecnología que hemos descubierto. Uno estaría tentado de decir: hay que prohibir estas nuevas tecnologías. Es muy naïf, siempre va a haber humanos en la Tierra que van a intentar clonar a la oveja Dolly, o ir a Marte, o alcanzar un nivel superior de conocimiento. Siempre. El conocimiento es imparable, crecerá sí o sí en la especie humana. Entonces, el gran problema es legislar a tiempo para que no se haga el mal. Ese es el gran problema que hace falta hacer. Luego, los Premios Nobel en el fondo es un accidente. A los humanos nos gusta dotarnos de premios y de parafernalia y de celebrities, pero el conocimiento de la especie no depende de ese Premio Nobel. Estaba cantado, por decirlo de alguna manera, en los años 60, que iba a aparecer esto, porque es con el nacimiento de los ordenadores ya cada vez más potentes. De hecho, la palabra “singularidad” que usamos hoy en día con mucha frecuencia es anterior a estos Premios Nobel. Es el científico John von Neumann, el mismo que ideó la arquitectura de un ordenador en zonas de procesamiento, de almacenamiento de entrada y salida, la arquitectura de Von Neumann, y también escribió un libro sobre los postulados de la mecánica cuántica en los años 30; en 1950 en una conferencia habla del acelerado progreso del conocimiento humano y cómo se aproxima a una singularidad. Un punto de no retorno con respecto a nuestra capacidad de utilizar las máquinas para generar conocimiento. Todo eso es anterior a estos Premios Nobel. Ellos son obviamente las personas que escribieron el primer artículo, pero si no hubieran sido ellos, habrían sido otros. Lo hemos descubierto, haya la persona Higgs o no haya la persona Higgs, y así esencialmente toda la ciencia. Hay un componente muy humano de dotarnos de premios y de reconocimiento. ¿Pero cuántos científicos hay en la Tierra? Son millones. Tarde o temprano todo eso habría pasado. Fíjese que muy poquito a poco ahora nadie sabría dar el nombre de un científico que está detrás del ChatGPT. A lo sumo daría el nombre del CEO de la empresa, no de los científicos que lo han hecho. Y es porque ese saber se ha abierto tanto que hay literalmente miles de personas en el límite del conocimiento que lo están creando. De ahí que no creo que haya ninguna manera de volver a los tiempos románticos donde todo dependía de que hubiera un genio, eso ya no va a pasar.

“A 40 años vista, el problema mayor de la humanidad va a ser el envejecimiento”

—Sí podríamos hablar de las condiciones de posibilidad. Por ejemplo, uno de los dos Premios Nobel de Física y uno de los dos Premio Nobel de Química trabajaron relacionados con Google DeepMind, ¿podríamos decir que ahí hay como un laboratorio que permite el desarrollo avanzado?

—Sí. Usted ahora está tocando un tema superimportante, si la ciencia, el conocimiento, es generado en universidades o en empresas. Hasta la fecha la gran ciencia se hizo en universidades. Einstein, la mecánica cuántica de Schrödinger, todos eran de instituciones educativas públicas. Es decir, el saber era ostentado por los gobiernos de las naciones. Hubo un primer intento de cambiar esta estructura cuando el ADN se secuenció. Hubo una famosa empresa en aquel instante que intentó secuenciar y patentar el genoma humano. En esa gran lucha ganaron las universidades públicas, por eso el genoma humano es conocimiento público. Usted puede descargar el genoma de un humano gratuitamente. En cambio, ahora tenemos esas grandes corporaciones que han invertido muchísimo dinero y que son las que tienen el límite del conocimiento, no las universidades, sino las corporaciones. De ahí que, de nuevo, hay un componente ético al que no nos hemos enfrentado todavía los humanos. Nunca había sucedido algo así. Había sucedido muy tímidamente. Estaban los Bell Labs, había algunas instituciones, por ejemplo en Estados Unidos, donde se desarrollaron prototipos de máquinas que sí eran privadas. Pero no era el gran conocimiento, eran aplicaciones. En cambio, ahora es el gran conocimiento lo que está en juego. Eso es muy preocupante, ha habido cartas en las comunidades en Europa, en concreto, de que las universidades deberían ser dotadas con centros de cálculo absolutamente comparables a los de las grandes empresas. La realidad es que los gobiernos sí que hacen un esfuerzo, pero no de la envergadura que es necesaria. Aquí en Singapur he participado en las reuniones, y directamente los gobiernos han decidido que no tienen tanto dinero como para tener granjas de millones de GPUs, no pueden, sencillamente no hay dinero para eso. Ahí se produce un hecho que para mí da un poquito de miedo. Y es que ahora, en la diferencia entre el poder de cálculo de las grandes corporaciones y la del sector público, se va a ir ampliando la distancia. Eso hace que el dinero va a fluir hacia esas corporaciones, porque las aplicaciones van a venir de ellas, y va a hacer que ellos paguen mejores sueldos. Por lo tanto, las mejores mentes, los más brillantes humanos, en vez de ir a las universidades, querrán ir a estas corporaciones. Y eso da vértigo. Al menos a mí me da un poquito de vértigo pensar que el futuro ya no está en las famosas grandes universidades, ya no estará en Harvard, ya no estará en Cambridge, no estará en la Sorbona, o en la Polytechnic, o donde sea, sino que va a estar en la futura empresa de alguien. Uno cuando se imagina las películas, siempre hay una corporación malévola que tiene el límite del conocimiento y hace el mal. Entonces esa distopía es más posible ahora.

—¿Y paralelamente, ese capital financiero solamente lo podrían tener dos grandes potencias, como Estados Unidos y China?

—Europa podría, desde luego. Es mucho más difícil, sin duda alguna para mí, objetivamente, en países pequeños y en países que tengan problemas de establecer programas potentes de investigación. O sea, puede haber países donde hay cierto cuerpo de gente que sabe, pero si el país es incapaz de hacer una apuesta muy firme, entonces no va a pasar tampoco. En cambio, está garantizado que va a pasar en Estados Unidos, está garantizado que pasar en China.

“Estamos ahora en plena batalla en la Tierra por liderar la nueva forma de computar”

—Y probablemente en Europa.

—En Europa. Por motivos de oficio, estoy en delegaciones constantemente, estuvimos en la Casa Blanca, hace poco estuve en China. El progreso es espectacular, no puedo decir más que eso. En mecánica cuántica, en China, visité un centro que hacen uno nuevo y son 180 mil metros cuadrados, eso es inviable en cualquier otro lugar. Curiosamente, no tienen el talento porque China vive de los pocos chicos que enviaron a estudiar al extranjero. Muchos estuvieron en Estados Unidos, en Europa. Ahora han vuelto y están haciendo una labor muy buena, pero la jerarquía china sigue ahí y por lo tanto se han desacoplado ya del sistema internacional, ya no avanzan a la velocidad que avanzaron. Y los siguientes que vienen detrás siempre son una copia peor de ellos. Curiosamente, cuando fui allá, a pesar de que tenía todo el dinero y todo lo que quisieran, estaban desesperados por establecer relaciones para poder mantener un flujo de sus estudiantes al extranjero. La ciencia de un país se construye en cien años, no en tres. Les llevará un tiempo desaparecer las jerarquías. La ciencia no puede depender de jerarquías, si cada profesor es mejor que sus estudiantes, pues, cada vez será peor todo. La ciencia tiene que permitir que un chico joven, una chica joven, cuestione el conocimiento de su maestro y, por lo tanto, vaya más allá. Eso está metido en la cultura de los países del oeste, no está en las culturas del Este. Con Confucio se acabó lo de criticar a tu jefe. En cambio, yo al menos iba en España y el tema es que te respeten en clase. Es triste cuando estás allá porque te sabe mal, por otra parte, uno se da cuenta de que de ahí sale gente muy lista, porque cuestiona.

“La computación cuántica será el instrumento para lograr la máxima IA posible”

—Usted dijo: “En el siglo XXI no va a haber derechas e izquierdas, va a haber una relación entre humanos y máquinas, y jóvenes y viejos”, me gustaría si pudiera ampliar esta idea.

—Lo digo con toda honestidad. Creo que estos coletazos constantes de izquierdas y derechas vienen de gente que no entiende el siglo XXI. En mi opinión. Cuando veo qué problema va a haber, si usted me dice cuál es el mayor problema a corto plazo, es la adecuación de máquinas a humanos, es la desaparición de puestos de trabajos, cómo vamos a gestionar que las decisiones no sean nuestras, qué vamos a hacer con los cajeros de los supermercados que ya no va a haber ni uno, etc. Si usted me pregunta a 40 años vista cuál es el problema mayor de la humanidad, va a ser el envejecimiento. Estamos avanzando a pasos agigantados para comprender por qué envejecemos. Es un mundo en el cual ahora estoy entrando a fondo porque queremos que Singapur sea un lugar para aplicar la computación cuántica a la biología computacional. Es decir, queremos comprender a fondo todo lo que está escrito en el ADN, en particular las mutaciones, el envejecimiento a través de genes que dejan de operar, cómo se rectifica eso. Creemos muchos de nosotros que ese umbral de pasar a 120 años está muy cerca, y nadie sabe más allá. Entonces, dígame usted: ¿cómo es una sociedad donde la gran mayoría de la gente es muy mayor? ¿Cómo se mantiene esa sociedad? ¿Cómo se hace equitativa? Va a haber una guerra entre jóvenes y viejos. No estamos preparados, nuestra sociedad no está preparada para ser una sociedad profundamente envejecida. No me refiero a que tengamos 80, no, a que tengamos 120. Durante el siglo XX, hemos ganado un mes de vida cada año, los humanos en el mundo del Oeste vivimos un mes más, cada 12 años vivimos un año más, y ahora estamos superando en todas partes los 80 años como promedio de vida. ¿Cómo se van a pagar esas pensiones? Sobre todo a tener trato personalizado, ¿cómo vamos a tener una medicina que garantice todo eso? Esos no son problemas de izquierdas y de derechas, es un problema para la humanidad, en mi opinión, insisto. Como es un problema para la humanidad al relacionarnos con las máquinas, qué va a sentir el humano, que ya es inútil, que no tiene ninguna utilidad para la sociedad, que se siente que “muérete ya”, tenemos a muchos. ¿Cómo vamos a garantizar que las nuevas generaciones no dependan totalmente de esos algoritmos, que sean todavía especie humana? Pues, en mi opinión, esos son los problemas que debemos afrontar. Polarizar cualquier problema en torno a izquierda y derecha me parece un error. Creo mucho en que la gestión de la política debería ser más tecnócrata. Es mi opinión. El ejemplo eterno es, desde que tengo uso de razón ha habido problemas de agua en mi ciudad, vivimos al lado del mar. Para mí el agua es un problema técnico, nada más. Si hay un problema técnico, la pregunta es: ¿hay una solución técnica? Y la respuesta es sí. Hay muchos países que han solucionado eso. Pues apliquémosla, no tiene nada que ver con ser de izquierdas o de derechas. Hay problemas técnicos, abastecer de electricidad la ciudad es técnico, resolvámoslo técnicamente. El de las comunicaciones, técnicamente. ¿Hemos de absorber una inmigración de una cultura diferente que viene sin educación a los 18 años y es masiva? Ese no es un problema técnico, es un problema muy serio. Entonces ahí hay que sentarse, todas las ideologías, y decidir cómo avanzar. Pero deberíamos restar, los problemas técnicos deberían ser resueltos por defecto. O sea, todo político debería ser impecable. Me reafirmo porque llevo años viviendo en Singapur y es así como funciona. Es un país donde cualquier problema técnico está resuelto. Contaminación no hay, el agua funciona perfectamente, la electricidad funciona perfectamente. Aquí llueve a cántaros, no hay un charco porque todas las carreteras son desagües para el país, existen zonas de retención de agua, toda gota de lluvia se utiliza dos veces. Son treinta años de ir mejorando un sistema técnico, y funciona. Los aeropuertos son impecables. ¿Por qué los baños de los aeropuertos en muchos países no funcionan y en otros funcionan de maravilla? Es un problema técnico, no es un problema de izquierdas o de derechas. Soy una persona profundamente política por creer en la gestión, pero apolítica en los sentidos de los partidos tradicionales.

“Singapur ha hecho un plan estratégico cuántico que, por científico, tiene una financiación mayor”

—Frente a la pérdida de trabajo que va a producir la tecnología, la discusión sobre la conveniencia o no de una renta, ¿podría ser resuelta por inteligencia artificial técnicamente?

—Es un tema que he debatido muchísimo. La renta universal da miedo a ciertas personas, otras la adoran porque ya ven ahí que no van a trabajar nunca. Con toda honestidad, me pongo la mano en el corazón, cuando uno hace números, cuando uno mira con detenimiento la pérdida de puestos de trabajo que se va a ir avecinando poquito a poco, y mira la realidad de nuestra sociedad, en algún instante va a ser inevitable. En qué condiciones, no se lo sé decir, pero creo que va a ser inevitable. Al día de hoy, si mira cuánta gente va un día cualquiera por una ciudad como Barcelona, verá que hay mucha gente que no trabaja, mucha. Ya tenemos clarísimo que las personas mayores no trabajan, que hay un paro natural. Hay muchísimas personas que no trabajan. Hay países, como decía un amigo mío, en que la renta básica es fiable, lo demuestra mi país; un señor de Israel, porque tenemos la mitad de población que no trabaja por motivos religiosos, y el país no funciona. Entonces se puede hacer de más y de menos en el tema de la renta básica, y creo que es un tema que hemos de empezar a explorar de forma equitativa, sin sesgo, porque si empezamos ya cuando intentamos hallar una solución, todo el mundo se pelea sin escuchar al otro. Necesitamos ir a la zona templada y hablar del futuro de la sociedad. Voy a ser muy exagerado, pero déjeme que le diga que dentro de un siglo trabajar será un privilegio.

“Europa es el estandarte de la ética, es donde más se evalúan las consecuencias de la tecnología”

—Ahí hay otro problema crucial, para Freud la felicidad de los seres humanos está en poder amar y poder trabajar, o sea, en poder amar, en ser trascendente, poder hacer algo, ¿si no podemos hacer algo, se acabará la humanidad?

—Por eso le he dicho que será un privilegio poder trabajar, de verdad lo creo. O sea, me quitan mi trabajo y me muero, quiero hacer esto. No tengo ninguna intención de levantarme por la mañana y no saber qué hacer. El gran éxito de gente que se sabe jubilar es que en el fondo no se jubila, se recicla, pasa a hacer otra cosa, pero no es que no haga nada. La palabra jubilar tenía sentido cuando el trabajo era duro, cuando el trabajo físicamente era duro, era agotador. Cuando el trabajo ya no es agotador. Cuando el trabajo aporta algo ya no es malo. Un vecino mío se jubiló y acabó siendo una de las personas importantes de una ONG, trabajaba gratuitamente para lograr el bien común. Ese es un ejemplo muy típico. Mucha gente mayor busca una ocupación que tiene que ver con hacer el bien para los demás. La gente lo que no quiere son obligaciones y horarios muy estrictos. Pero yo creo que todo eso lo podemos trabajar. Poco a poco podemos establecer nuevas formas de trabajo que permitan esa flexibilidad que la mente humana pide y que nos hará bien a todos en conjunto. ¿Usted se quiere jubilar?

—No.

—Pues ya está. Yo tampoco.

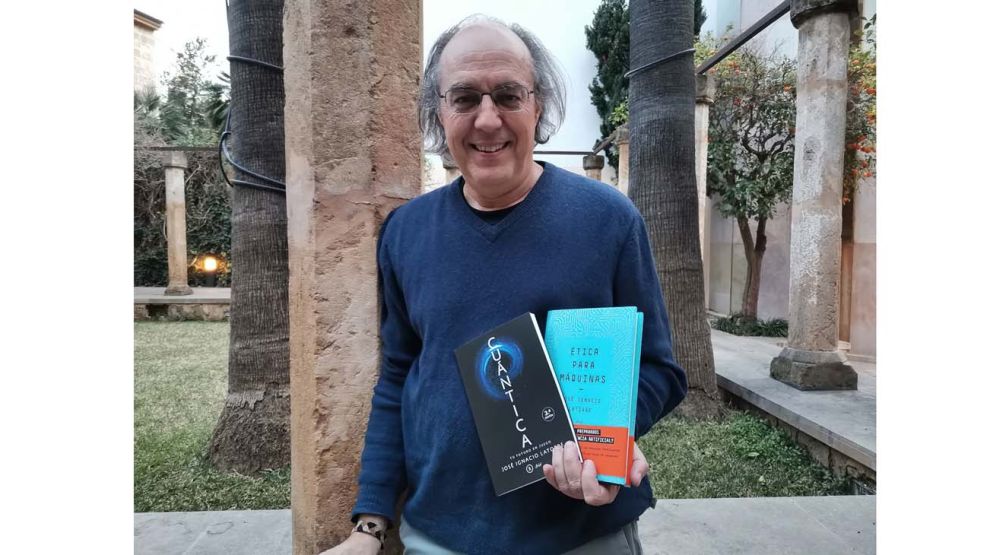

—Confucio decía aquello de que afortunado aquel que no se sabe si está jugando o trabajando. Ojalá la inteligencia artificial nos permita hacer un trabajo que posibilite sentir que se juega. Profesor José Ignacio Latorre, encantadísimo por esta conversación y esperamos verlo en Argentina pronto. Le mando un abrazo fraterno desde este otro lado del mundo.

—Y yo les envío un abrazo a todos mis amigos argentinos, que son muchos, y ya he visitado su país, di charlas en su país. O sea que espero, pues, claro que sí, volver a su país.

Producción: Sol Bacigalupo.