La irrupción de Deepseak, la nueva inteligencia artificial, de origen chino, vierte más agitación en la atmósfera del tecnomundo actual.

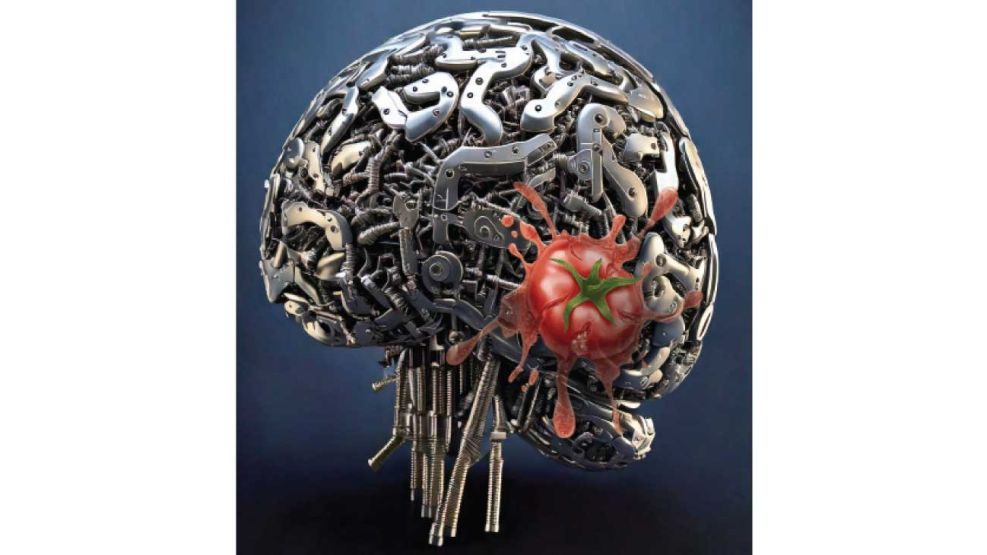

Esto no altera que la inteligencia artificial (IA) es ya una inmensa incógnita de cara al futuro. ¿Sus rendimientos discurrirán básicamente en un carril de progreso continuo? ¿O sus efectos perfeccionarán un pandemónium de control y vigilancia, y de manipulación de la opinión pública? Sus consecuencias, ¿diluirán definitivamente la frontera entre lo real y lo falso para llevar el reino de la desinformación y la posverdad a su estadio más alto, con su erosión de la calidad del debate público en los países democráticos? O la IA es solo un nuevo servicio que, por su alta demanda, genera lo que las empresas informáticas buscan: concentrar poder económico, tener una creciente influencia en las decisiones políticas, e intervenir también en el desarrollo tecnológico en general y en la tecnología de guerra, cuya presencia es cada vez mayor en una geopolítica de divisiones y confrontaciones en alza.

Poco después del boom de la IA, Elon Musk y el cofundador de Apple, Steve Wozniak, firmaron, junto con muchos otros, una carta en la que solicitaban una interrupción de seis meses en el desarrollo de los sistemas de IA por sus inciertas consecuencias.

Pero en la primera etapa del siglo XXI lo cierto es que se puede distinguir dos tipos de habitantes del territorio de la IA: aquellos que actúan como detractores que advierte el rugir de una tormenta destructora, y los que avizoran nuevos campos de flores en la expansión de la IA.

La IA estalló con el chat GPT de OpenAI como una revolución no solo técnica sino cultural: de la anterior inteligencia artificial débil, como los asistentes virtuales, los chatbots de atención al cliente, o los robots de los motores de búsqueda de internet, a la imitación de las capacidades humanas lingüísticas y cognitivas. El poder de replicar las estructuras del lenguaje natural, de formular oraciones como respuestas a preguntas de los usuarios; o soluciones de problemas matemáticos, la escritura de código informático, la elaboración de virtuales artículos, ensayos o ficciones a pedido; lo mismo que sugerencias para presentar tesis, elaborar argumentos, guiones o estrategias comerciales o de estudios. La mimesis de las habilidades humanas también se extiende a la creación de imágenes, sonidos, voz o música, canciones o videos.

Mucho se debate sobre la posibilidad de que el actual proceso de autoaprendizaje de la IA alcance, en su altura máxima, el Santo Grial de la autonomía, la IA fuerte, la máquina consciente de sí misma, que es capaz de tomar decisiones totalmente ya independizada de una programación previa. Pero todo esto, nuevamente, ¿es una luz cuyo resplandor se aviva, o una fría oscuridad cuyos brazos nos oprimirán con más fuerza?

La voz de la advertencia. El estado de las interpretaciones actuales de la IA se asemeja a Jano, el dios romano de las dos caras que miran en direcciones opuestas. Si trasladamos esa dualidad a la comprensión contemporánea sobre la IA debemos atender a las posiciones de adhesión o rechazo respecto a esta tecnológica avanzada. Empecemos primero por quienes representan la voz de la advertencia. Uno de los primeros en clamar contra el lado oscuro de la IA es Geoffrey Hinton.

Hinton es un científico computacional y psicólogo cognitivo británico. Llamado el “padrino” de la inteligencia artificial, renunció a Google a los 75 años para difundir, con más libertad, lo que entiende son los peligros de la IA.

En muchas entrevistas, Hinton manifiesta que la IA podría llegar a escribir y ejecutar su propio código y alcanzar la autoconciencia. Pero para que “estas cosas puedan llegar a ser más inteligentes que las personas… faltan de 30 a 50 años o incluso más”. Cuando los sistemas de IA alcancen la conciencia de sí, si es que la alcanzan, “sabrán manipular a las personas. Aprenderán de todas las novelas de Maquiavelo, de la política y la manipulación humana”. Mientras tanto, la IA ayudará a un aumento significativo de la producción, lo que dará “más dinero a las grandes empresas y a los ricos, aumentando todavía más el hueco entre los ricos y la gente que va a perder su trabajo”. Esto último recuerda la inevitable crisis laboral futura que provocará el paso de una vieja matriz de empleos y profesiones a los nuevos perfiles laborales adaptados a las exigencias de un mudo dominado por la IA, la robótica y el constante cambio tecnológico.

Mustafá Suleyman es otro de los compungidos pregoneros del peligro. Empresario e investigador, Suleyman es CEO de Microsoft AI, y cofundador y director de DeepMind, una empresa de IA aplicada.

Suleyman observa que la IA sin debidas restricciones alienta su uso para estafas y afecta a la ciberseguridad. Los desfalcos por IA han aumentado, mediante el recurso, por ejemplo, a la clonación de la voz de personas para obtener los datos para vaciar cuentas bancarias. O la creación de deepfakes, imágenes, videos, audios manipulados con inteligencia artificial que muestran a una persona real o ficticia en situaciones falsas, lo que también es un engranaje para posibles fraudes.

En una perspectiva mucho más peligrosa, Suleyman también advierte que los virus manipulados por IA podrían “propagarse más rápido o ser más letales”. Su poder de dañar sería mayúsculo, y podría generar una mortandad “como una pandemia”.

La IA no es capaz de diferenciar su uso para el bien o para el mal. Por lo que “no podemos dejar que cualquiera tenga acceso a ellas. Necesitamos limitar quién puede usar el software de IA, los sistemas en la nube e incluso algunos de los materiales biológicos”, dice en una entrevista con El Economista. Desde este ángulo de intranquilidad, Suleyman promueve la incipiente Ética de la IA que brega por el aumento de responsabilidad de la sociedad civil, de las empresas y los gobiernos, para regular y asimilar las novedades que traen los tecnólogos. En esta dirección se sitúa el libro que, en 2023, escribió en colaboración con el investigador Michael Bhaskar: La ola que viene: Tecnología, poder y el gran dilema del siglo XXI, en el que propone restricciones a las nuevas tecnologías en aras de un mundo más sano y sostenible.

Al coro de las advertencias se suma Yoshua Bengio, informático canadiense, reconocido por su trabajo en redes neuronales artificiales y aprendizaje profundo, y galardonado en 2022 con el Premio Príncipe de Asturias de Investigación Científica y Técnica.

En una intervención en Davos, Bengio compartió su preocupación por los agentes de IA con capacidades cognitivas similares a las humanas, conocidas como inteligencia general artificial (AGI). Esto podría suponer un inquietante peligro si no se introducen claras pautas de control. Ejemplo de esta amenaza son, por ejemplo, los sistemas de armas autónomas, y sus eventuales decisiones de destrucción sin intervención humana. A su vez, los agentes de IA podrían actuar como difusores de desinformación y propaganda en detrimento de los valores esenciales de la democracia. En una entrevista concedida a Business Insider, Bengio también declaró que “el problema es que las personas seguirán construyendo agentes sin importar qué, especialmente porque las empresas y los países competidores temen que otros logren alcanzar primero la AGI autónoma”. Esto exige asumir la inversión tecnología que es indispensable para “garantizar la seguridad antes de que sea demasiado tarde y construyamos cosas que puedan destruirnos”.

Por su parte, el experto en inteligencia artificial Eliezer Yudkowsky es fundador del Instituto de Investigación de Inteligencia de Máquinas en California. En una entrevista para el periódico The Guardian, “Cinco formas en las que la IA podría destruir el mundo: Todos en la Tierra podrían caer muertos en el mismo segundo”, expresa su posición en un artículo en el que, junto a otros cuatro especialistas confluye en una turbia visión apocalíptica respecto al auge de la IA. Según su entender, la inteligencia artificial general podría, tarde o temprano, causar la destrucción del planeta. Si no se introduce una clara mediación ética y responsable en su uso el peligro podría cristalizarse en realidad: “Si es mucho más inteligente que nosotros, entonces puede conseguir más de lo que quiera. En primer lugar, quiere que nos matemos antes de que construyamos más superinteligencias que puedan competir con él”. O la IA hiperinteligente podría ensayar matarnos desde una estrategia oblicua como construir “tantas centrales eléctricas que funcionen con fusión nuclear (porque hay mucho hidrógeno en los océanos) que los océanos hiervan”. Yudkowsky supone que la inteligencia artificial consciente supondría una alteridad radical; algo que, afirma en una conferencia TED, “no quiere nada que a nosotros nos parezca valioso”. Por eso es muy difícil imaginar el conflicto entre el sapiens y lo totalmente distinto de una inteligencia artificial superior. La única solución, dice en tono humorístico, sería acabar con la IA bombardeando sus centros de datos.

Y Evgeny Morozov, escritor e investigador bielorruso, autor de La locura del solucionismo tecnológico, postula una rectificación de los términos conceptuales en la base del debate: la declamada inteligencia artificial no es en realidad inteligente. Y esto porque la IA no “puede tener un sentido del pasado, el presente y el futuro; de la historia, de lo que hiere o de la nostalgia”. La IA no trasciende el horizonte de una lógica formal singular; carece de discernimiento de contextos, de posibles sentidos de significados distintos por la intervención de las emociones (“veo la Luna”, por caso, no solo alude solo a un cuerpo astronómico, sino a una fuente de emociones poéticas). En su óptica humanista, la vía a la inteligencia no son solo datos y algoritmos, sino el crecimiento de la mente mediante el estudio de la historia, la filosofía o la literatura.

Gritos, o susurros, de victoria. Los detractores divergen de quienes tienen una mirada mucho más moderada o matizada respecto al fenómeno de la IA. Un representante de este último grupo es Yann André LeCun, muy importante informático franco-estadounidense. Junto con sus antiguos colaboradores, Geoffrey Hinton y Yoshua Bengio, es señalado como uno de los “padres de la inteligencia artificial”. Ayudó a promover el enfoque del aprendizaje profundo o autoaprendizaje. Hoy científico en jefe de IA de Meta, LeCun no acuerda con los que denuncian a la IA como “riesgo a escala social”, o amenaza existencial de tintes apocalípticos. Con otra visión, LeCun acompaña la flecha de progreso, según él, que vuela impulsada por las nuevas tecnologías. Firmó una carta abierta dirigida a Joe Biden en la que exhorta a proteger la IA de código abierto y declara que “no debería estar bajo el control de unas pocas entidades corporativas selectas”. No cree que la IA con capacidad de conciencia humana sea un hecho. Por eso no acuerda con quienes creen que pronto se alcanzará una réplica plena de la inteligencia humana. Eso no es así, advierte. La revista Esquire recoge su opinión de que “la inteligencia humana es demasiado especializada para ser replicable”.

Y en una entrevista con la revista Wired, observa que el discurso alarmista sobre la IA se nutre del profundo y ancestral miedo a la tecnología. El avance tecnológico siempre implica el cambio, y esto sacude las estructuras más cómodas y conocidas. Además, entre los muchos beneficios de la IA que LeCun pondera, y en contra de lo que muchos suponen, ésta puede contribuir de forma eficaz a combatir el odio en las redes. Por eso, desde su rol en Meta afirma que “hace cinco años, de toda la incitación al odio que Facebook retiraba de la plataforma, entre el 20 y el 25% era eliminada preventivamente por sistemas de IA antes de que nadie la viera. El año pasado fue el 95%”.

La postura optimista de LeCun no niega la necesidad de regulaciones, pero discute sus modos. Además, evidencia que, en la cima de los grandes especialistas, se puede disentir en alto grado.

Entre los mensajeros de la evolución triunfal de la IA amigable se destaca, y ya desde hace décadas, Ray Kurzweil, inventor estadounidense y científico especializado en Ciencias de la Computación e inteligencia artificial. Desde 2012 es director de Ingeniería en Google e impulsa la Universidad de la Singularidad de Silicon Valley.

Kurzweil postuló la Ley de Rendimientos Acelerados que asegura que cada vez hay más cambio tecnológico en menor tiempo. En una entrevista con el podtcaster Joe Rogan, Kurzweil afirma que “para el año 2029, la IA igualará la inteligencia humana en general”.

La hélice del progreso de la IA es movida por muchos campos, uno de ellos es la medicina: “podremos desarrollar medicamentos personalizados en cuestión de días”. Kurzweil agrega que curarán enfermedades como el cáncer y el Alzheimer; se revertirá el envejecimiento y el promedio de vida trepará notablemente, lo mismo que las capacidades cognitivas; se desarrollarán nuevas fuentes de energía limpia; se optimizará la agricultura para alimentar a una población creciente y surgirán nuevas estrategias efectivas para combatir el cambio climático.

Pero el gran salto, según Kurzweil, será en 2045 cuando acontezca la “Singularidad”. Entonces, la IA superará vastamente a la inteligencia humana. Adquirirá autonomía. Se mejorará a sí misma. “En ese punto, la IA podrá hacer cosas que hoy no podemos ni concebir”.

El optimismo de Kurzweill no es un sol sin manchas. Admite que la IA “podría ser catastrófica si se usa para fines maliciosos”, pero “los beneficios superarán a los riesgos si la desarrollamos con sabiduría”.

Otros de los adalides protectores del potencial de la IA es Andreessen y, con muchos matices, Bostrom. Marc Andreessen es cofundador de la empresa Netscape Communications Corporation. En su difundido ensayo La IA salvará al mundo, asegura que todos los beneficios de la IA se asientan sobre su capacidad “de aumentar profundamente la inteligencia humana” a fin de obtener nuevos medicamentos, resolver el cambio climático y desarrollar tecnologías para llegar a las estrellas.

Nick Bostrom, por su lado, es un conocido transhumanista y pensador de la tecnología. En su libro Caminos, peligros, estrategias (2014), advertía que la IA podría volverse en contra de la humanidad y eliminarla. Pero en su nuevo libro Utopía profunda: vida y sentido de un mundo resuelto (2024) plantea, sin abandonar del todo dudas y reticencias, un futuro en el que la humanidad se deslizará hacia las máquinas superinteligentes sin que esto suponga un desastre sino un probable horizonte de progreso benefactor. En lo más cercano, y entre otros muchos aspectos, Bostrom, también en una entrevista de Wired, asegura que se radicalizará “el uso de la IA en campañas políticas, de marketing, sistemas de propaganda automatizados. Pero si tenemos un nivel suficiente de sabiduría, estas cosas podrían amplificar realmente nuestra capacidad de ser ciudadanos democráticos constructivos, con asesoramiento individual que explique qué significan para ti las propuestas políticas”.

La profunda incertidumbre. Las posturas tan distintas entre los entendidos muestran con claridad que una profunda incertidumbre campea en lo referido al nuevo mundo que abre la Revolución de la IA.

En el trasfondo de las posiciones apocalípticas rebulle el miedo respecto a los poderes tecnológicos. Algo que los griegos antiguos manifestaron en los mitos de Prometeo o Ícaro; en el mundo moderno, Mary Shelley imaginó el paso tecno-científico monstruoso en su Frankenstein; y en la cultura popular cinematográfica la saga de Terminator avizoró, ya hace cuarenta años, una inexorable rebelión de las máquinas.

En la tesitura básicamente optimista sobre la IA late una mezcla de moderación (LeCun), o un profetismo con visos dogmáticos por su poco margen para las dudas (Kurzweil).

Pero, en todos los casos, solo el futuro iluminará la línea del horizonte aún saturada de incertidumbres y temores.